Vivimos unos que mese en los que, de asentarse todo lo que estamos viendo, puede que dentro de varias décadas se estudien en los libros de historia. Las presentaciones de distintas alternativas de Inteligencia Artificial y los intentos de las grandes tecnológicas por implantarla en nuestro día a día abre multitud de interrogantes sobre el futuro de la economía, el trabajo, la información o la creatividad.

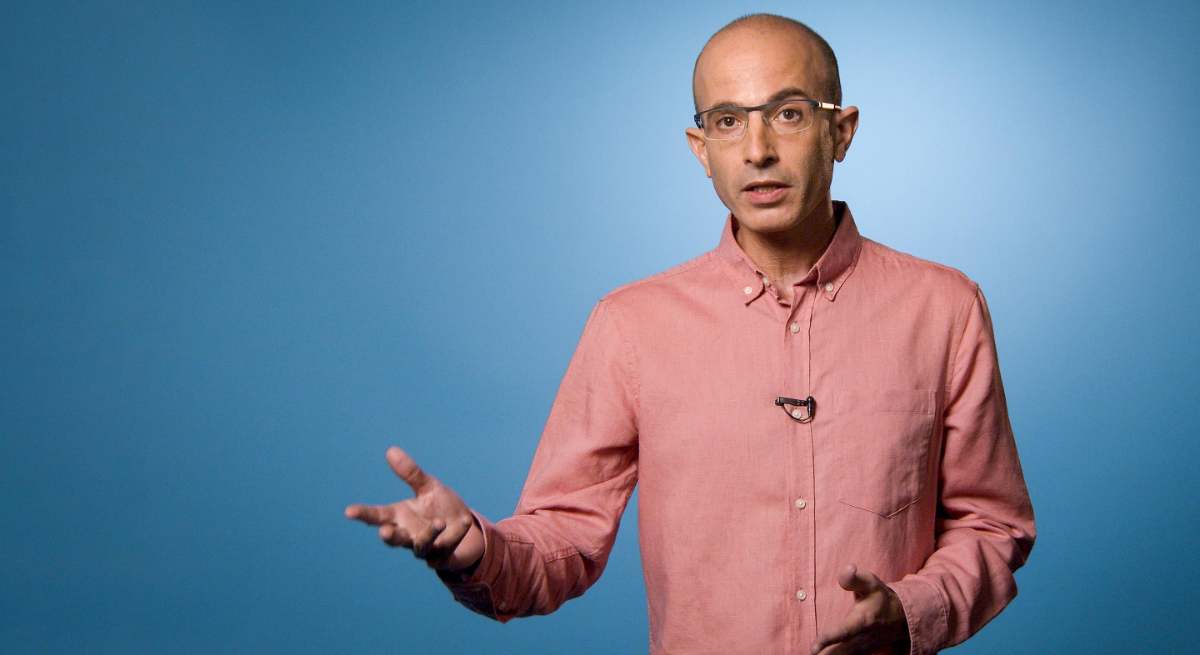

¿Cómo adaptarse a tantos cambios y cómo nos puede afectar? El historiador Yuval Harari -autor de los best-sellers Sapiens u Homo Deus- cree que la IA se trata de "la tecnología más trascendental de la humanidad", y que la carrera por dominar el mercado "no debería estar marcada por la velocidad". En su lugar, argumenta, "deberíamos movernos a la velocidad que nos permita hacerlo bien".

Harari compartió sus ideas el viernes en un artículo de opinión en el New York Times escrito con Tristan Harris y Aza Raskin, fundadores de la organización sin ánimo de lucro Center for Humane Technology, cuyo objetivo es alinear la tecnología con los mejores intereses de la humanidad. Argumentan que la inteligencia artificial amenaza los "cimientos de nuestra sociedad" si se utiliza de forma irresponsable.

El 14 de marzo, OpenAI, respaldada por Microsoft, lanzó GPT-4, la evolución de su modelo de lenguaje que alimenta a ChatGPT, mucho más potente. Harari y sus colaboradores escriben que es "difícil para nuestras mentes humanas comprender las nuevas capacidades de GPT-4 y herramientas similares, y es aún más difícil comprender la velocidad exponencial a la que estas herramientas están desarrollando capacidades aún más avanzadas y potentes".

El cofundador de Microsoft, Bill Gates, escribió la semana pasada también en su blog que el desarrollo de la inteligencia artificial es "tan fundamental como la creación del microprocesador, el ordenador personal, Internet y el teléfono móvil". Y añadía: "Industrias enteras se reorientarán en torno a ella. Las empresas se distinguirán por lo bien que la utilicen".

Por qué la inteligencia artificial es peligrosa según Harari

Harari y sus coautores reconocen que la inteligencia artificial bien podría ayudar a la humanidad, señalando que "tiene el potencial de ayudarnos a vencer el cáncer, descubrir fármacos que salven vidas e inventar soluciones para nuestras crisis climática y energética". Pero en su opinión, la IA es peligrosa porque ahora domina el lenguaje, lo que significa que puede "hackear y manipular el sistema operativo de la civilización".

Se preguntan qué significaría para los humanos vivir en un mundo en el que una inteligencia no humana da forma a un gran porcentaje de las historias, imágenes, leyes y políticas con las que se encuentran.

Y añaden: "La inteligencia artificial podría devorar rápidamente toda la cultura humana -todo lo que hemos producido durante miles de años-, digerirla y empezar a producir a borbotones una avalancha de nuevos artefactos culturales".

Los artistas pueden dar fe de que las herramientas de inteligencia artificial se "comen" nuestra cultura, y un grupo de ellos ha demandado a las empresas que están detrás de productos como Stability AI, que permite a los usuarios generar imágenes sofisticadas introduciendo texto. Argumentan que las empresas utilizan miles de millones de imágenes de Internet, entre ellas obras de artistas que no dieron su consentimiento ni recibieron compensación por el acuerdo.

Harari y sus colaboradores sostienen que el momento de tener en cuenta la Inteligencia Artificial es "antes de que nuestra política, nuestra economía y nuestra vida cotidiana pasen a depender de ella", y añaden: "Si esperamos a que se produzca el caos, será demasiado tarde para remediarlo". Debemos "aprender a dominar la I.A. antes de que ella nos domine a nosotros", sostiene.

Sam Altman, consejero delegado de OpenAI, ha argumentado que la sociedad necesita más tiempo para adaptarse a la inteligencia artificial. El mes pasado, escribió en una serie de tuits: "La regulación será crítica y llevará tiempo resolverla... tener tiempo para entender lo que está pasando, cómo la gente quiere usar estas herramientas y cómo la sociedad puede coevolucionar, es crítico".

También advirtió de que, aunque su empresa ha hecho todo lo posible para evitar usos peligrosos de la GPT-4, pero que alguien le haga preguntas encaminadas a malos usos es un reto que siempre va a estar ahí.