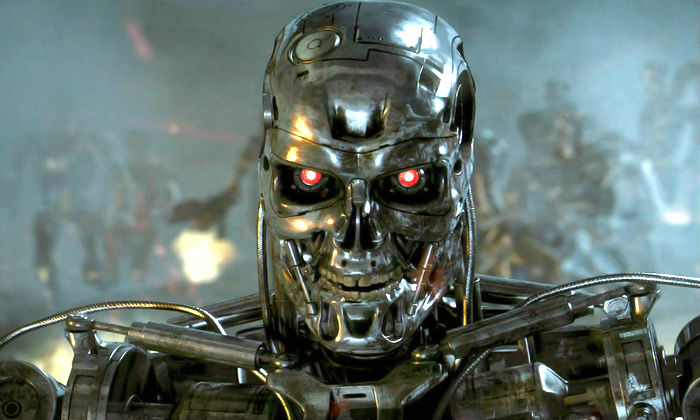

Varios grupos de activistas, entre ellos la premio Nobel de la Paz de 1997, Jody Williams, han pedido hoy a la comunidad internacional que inicie los trámites necesarios para legislar sobre los sistemas de armas y prohíban las armas robóticas completamente autónomas, conocidas como 'robots asesinos', llamando a la necesidad de que sean los países los que conserven el "control humano significativo" de esta tecnología.

El próximo 14 de abril se debatirá en las Naciones Unidas la creación de un marco legislativo para estos sistemas autónomos letales, dentro de la convención de Ciertas Armas Convencionales (CCW) a la que se espera que asistan muchos de los 122 países que se han adherido a la convención.

Pese a que casi una treintena de países se oponen abiertamente al desarrollo de armamento autónomo y abogan por crear un marco legal que defina cómo y cuándo deben usarse, países como Estados Unidos, Rusia o China, si bien no bloquean, no propician el establecimiento de dicha regulación.

Según explicó en una rueda de prensa el director del Comité Internacional para el control de robots-armas, Noel Sharkey, por ahora ningún país bloquea la idea de crear el marco legal, pero al mismo tiempo no se avanza en el proceso. cada dilación permite que tanto los países como las empresas sigan desarrollando este tipo de armas sin ningún control internacional.

Para el activista, el peligro reside en que estos países, que ya cuentan con ciertas tecnologías previas a los sistemas autónomos totales, pidan "más tiempo y más reuniones y sólo dilaten el proceso regulador".

"Las máquinas han servido durante mucho tiempo como instrumento de guerra, pero históricamente los seres humanos han dirigido la forma en que se utilizan", dijo Bonnie Docherty, investigadora principal de la División de Armas de HRW y autora principal del informe, quien añadió que "ahora hay una amenaza real de que los seres humanos podrían renunciar a su control y delegar decisiones de vida o muerte a las máquinas".

"Los seres humanos deben tener el control de los sistemas de armas y los ataques individuales, no sólo en las actuaciones generales", dijo Docherty, quien apuntó que ello "ayudaría a evitar las amenazas a los principios morales fundamentales sobre la decisión de utilizar la fuerza".

"Pueden repetir lo mismo durante cien años"

La definición de lo que es un arma autónoma es uno de los escollos principales, dado que existen múltiples interpretaciones al respecto. "Ni siquiera hemos sido capaces de definir lo que quiere decir 'control humano significativo'... aunque algunos tengamos muy claro qué significa", señaló Williams.

Asimismo, los activistas explicaron que en estos casos es difícil acotar la definición de arma letal, ya que, según Sharkey, "se puede matar de muchas formas" y con armas que a priori no serían letales, como los taser (pistolas eléctricas) o las pelotas de goma. Además, los expertos mostraron su preocupación por quién asumiría la responsabilidad por estas máquinas, es decir si hubiera errores fatales, qué persona o instancia pagaría por ello.

"¿Quién respondería, el programador? ¿La empresa fabricante? ¿El dueño de la máquina...? No se puede encarcelar a un robot, y aunque lo hiciéramos, daría igual. Una máquina no debería ser capaz de matar a una persona por sí sola, no hay más que decir", concluyó Williams.